Der Ethik-Kompass ist ein Workshop-Konzept, welches die Berücksichtigung von Diversität und Teilhabe im Kontext von KI behandelt.

Bachelorprojekt von Jessica Hammer und Julia Metzmaier

7. Semester, 2019

Betreuende Dozent*innen: Andrea Krajewski, Garrit Schaap, Stefan Voigt, Dieter Stasch

Interactive Media Design

Neutrale Technologie? Da Sie auf der Seite von IMD sind, wundert es Sie bestimmt nicht, dass wir Technologien aus jedem Blickwinkel betrachten. So ist auch die folgende Arbeit entstanden. Gerade im Bereich der künstlichen Intelligenz sieht das Team Handlungsbedarf bei der Entwicklung eben solcher Systeme, gerade was die Förderung von Diversität und Teilhabe in jenem Kontext angeht. Primär geht es um teilhaberelevante Entscheidungssysteme, die uns umgeben, um Diskriminierung durch jene Systeme und wie diese Diskriminierung vermieden werden kann.

Denn Technologie ist ganz und gar nicht neutral, wie sie oft jedoch wahrgenommen wird. Sie ist nur so gut wie der Mensch, der sie geschaffen hat.

Das im Rahmen des Bachelorprojekts entstandene Workshopkonzept gibt Orientierung und hilft dabei, ein Bewusstsein für die Auswirkungen der Problematik zu schaffen. Es bietet konkrete Hilfsmittel, um im Arbeitsalltag aufkommende ethische Fragen zu beantworten, Diskriminierung zu verstehen – besonders wenn man selbst nicht davon betroffen ist – und den Blickwinkel somit in Bezug auf Diversität zu erweitern.

Das Problem

Es gibt zahlreiche Beispiele von Diskriminierung durch KI oder algorithmische Entscheidungssysteme, sei es, dass Frauenstimmen von Sprachassistenen schlechter verstanden werden oder die Diskriminierung von People of Color (kurz PoC) wenn diese von einer Gesichtserkennungssoftware nicht oder falsch wahrgenommen werden. Die Systeme sind noch lange nicht perfekt und es wichtig ist, dass sich im Kontext der Entwicklung mit Ethik, Förderung von Diversität und Teilhabe auseinandergesetzt wird.

Eine nicht vielfältig genug betrachtete Situation äußert sich dadurch, dass in den Algorithmen der Entscheidungssysteme Biases (engl. Verzerrungen) auftreten, einseitige Verzerrungen, die zu Ausschluss oder Vernachlässigung von Personengruppen führen, weil sie diese nicht abdecken.

Welche Art von Verzerrungen gibt es?

Technischer Bias: Hier können u. a. technische Vorgaben verantwortlich dafür sein, dass Gruppen unterschiedlich behandelt werden. Das können Standardisierungen sein, die bestimmte Eingaben nicht zulassen oder auch verschieden große Bildschirme, was zur Folge hat, dass aufgrund der Größe beispielsweise weniger Ergebnisse gezeigt werden und diese natürlich auch bevorzugt beachtet werden im Vergleich zu Ergebnissen, die erst auf weiteren Seiten erscheinen.

Emergenter Bias: Das Zusammenspiel von Software und Anwendung kann zu Diskriminierung führen, wenn beispielsweise Ausgaben falsch interpretiert werden oder eine Software in einem anderen Kontext eingesetzt wird, für den sie eigentlich nicht geeignet ist. Dieser Bias zeigt sich oft erst nach einer Weile, wenn Werte oder Handlungsmuster, etc. sich ändern, die Technologie aber dieser Änderung nicht (schnell genug) nachkommt.

Prä-existierender Bias: Hier fließen gesellschaftliche Vorurteile oder Wertvorstellungen in die Software mit ein, was bewusst oder unbewusst passieren kann.

Basis des Ethik-Kompasses

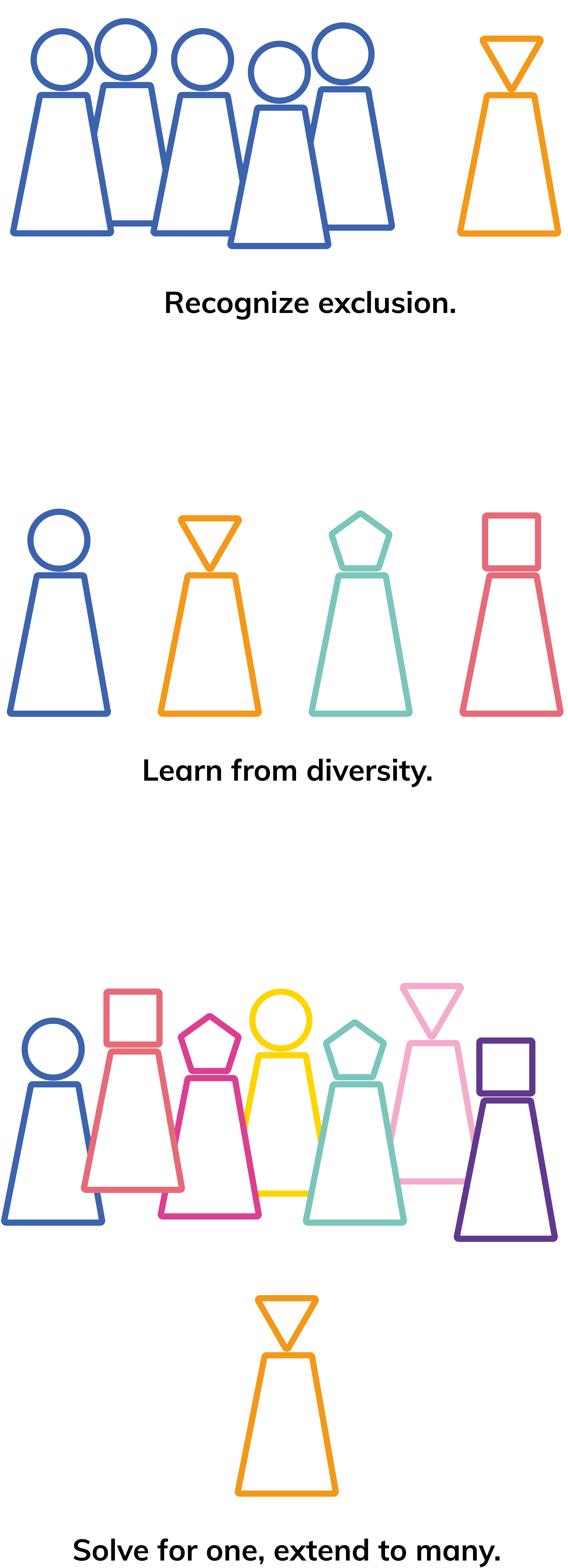

Die Prinzipien von „Design for Inclusion“ werden im Rahmen des Workshops und der Anwendung des Toolkits praktisch vermittelt.

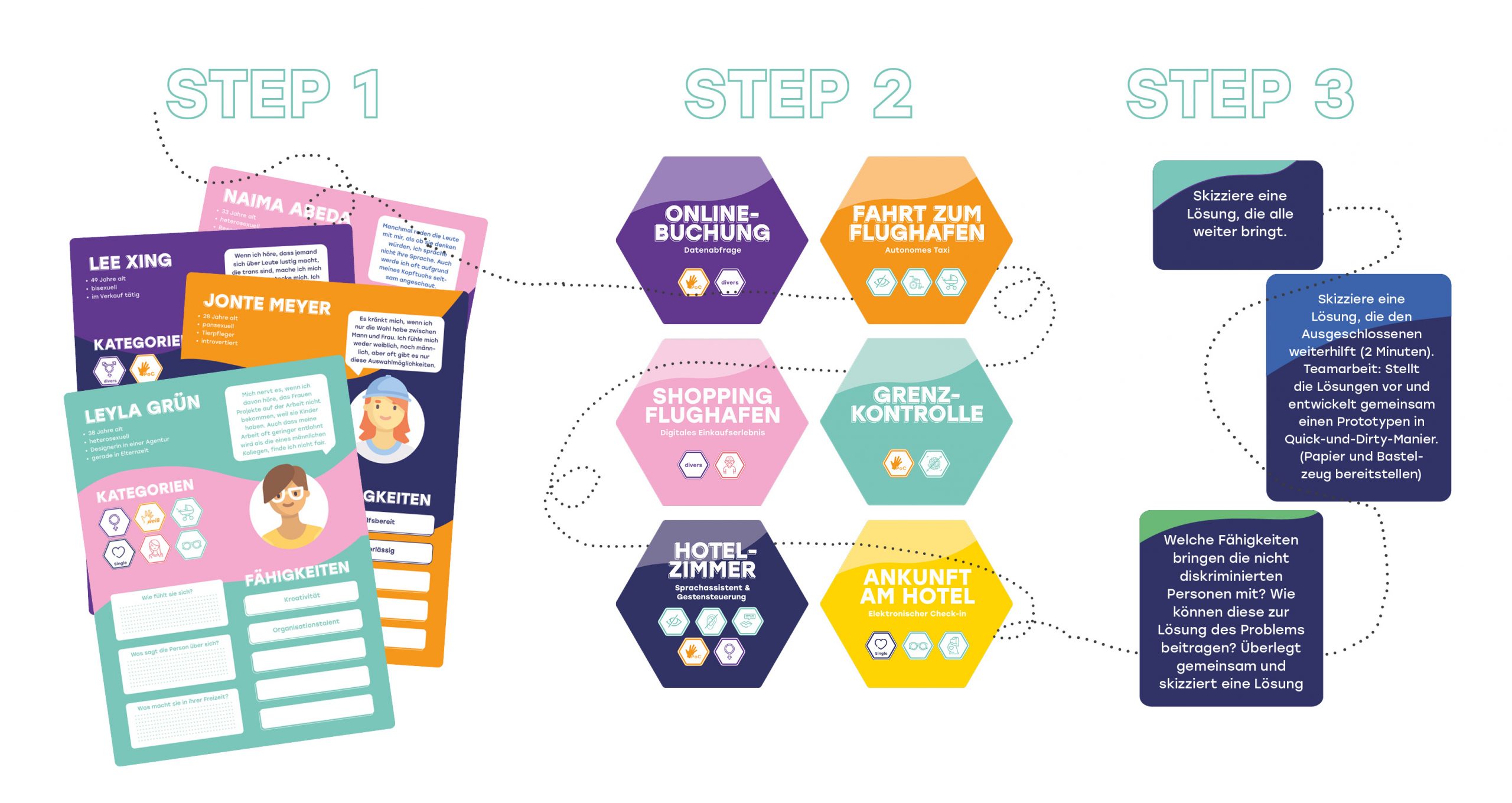

Step 1: Empathie

Personenkarten geben den Teilnehmenden einen Einblick in die Situation eines bestimmten Charakters, sie lernen ihn kennen und erfahren, wie

diese Person Diskriminierung, bzw. Benachteiligung erfährt. Zusätzlich sind der Beruf und einige Eigenschaften und Fähigkeiten vorgegeben. Sie selbst versetzen sich nun in die Lage der Person.

Step 2: Umdenken

Im Workshop begibt man sich als Gruppe auf eine imaginäre Reise. Verschiedene Szenarien von der Buchung bis zur Ankunft am Urlaubsort versetzen die Teilnahme in ein spannendes Abenteuer. In welchen Szenarien wird dein Charakter anhand der Kategorien diskriminiert? Wie entsteht der Bias im System und wie kann man diesen vermeiden?

Step 3: Lösungen

Nachdem man sich in die Rolle versetzt hat und verschiedene Blickwinkel erlebt hat, werden aus den Ursachen, die dazu führen, dass Biases entstehen, Lösungen erarbeitet. Zum einen werden Leitlinien entwickelt, an denen sich in Zukunft orientiert werden kann.

Komponenten