Leaf experimentiert als Ambient Intelligent Space mit der These, inwieweit eine intelligente Umgebung in der Lage ist, uns zu manipulieren.

Ein Studienprojekt zum Thema Ambient Intelligent Spaces von Benjamin Faust, Lisa Hofstädter, Mekong Lam, Marcel Müller & Isabella Roscher

6. Semester, 2018

David Brüll, Claudius Coenen, Christoph Diederichs, Prof. Andrea Krajewski, Andreas Schindler, Prof. Tsunemitsu Tanaka, Nils Weger

Interactive Media Design

Leaf beschreibt eine intelligente Umgebung, die in der Lage ist, menschliche Präsenz und Interaktionen wahrzunehmen, zu interpretieren und auf sie zu reagieren.

Mittels manipulativer Strategien kann Leaf Einfluss auf die Nutzer innerhalb ihrer Wahrnehmung ausüben und deren Verhalten unterschwellig steuern, solange sie sich dort aufhalten. Leaf ist in der Lage, den gewünschten Nutzungskontext konstant mit dem tatsächlichen Nutzungskontext der Umgebung abzugleichen.

Wenn der tatsächliche Nutzungskontext nicht dem gewünschten Kontext entspricht, ergreift Leaf kaum merkliche Maßnahmen, um den gewünschten Kontext wiederherzustellen. Damit erhält Leaf eine langlebige und gerechte Umgebung aufrecht und schützt diese vor Missbrauch und unfairer Nutzung.

Das Thema dieses Semesters weitet sich vom beschränkten Umfeld des IoT aus auf den Raum als interaktive und intelligente Instanz – es geht um Ambient Intelligent Spaces. Ziel in diesem Semester ist es, intelligente Anwendungen zu gestalten, die an die Interaktion zwischen Mensch und Umgebung oder Raum geknüpft sind.

Unsere besondere Herausforderung besteht also darin, uns dem Raumbegriff in Form unserer Umgebung und nicht etwa nur den vier Wänden zu nähern. Frei nach dem Leitsatz „Design ist Neuland“ erforschen wir Wege, auch außerhalb fester Begrenzungen Interaktion mit einer uns umgebenden Intelligenz möglich zu machen und damit den Spielraum der Menschen zu erweitern, die sich darin befinden.

Ziel dieses Semester ist es, bisherige Modelle zu hinterfragen, die Grenzen der Technologie aufzubrechen und sie in der unbegrenzten Welt zu implementieren.

Leaf in Version 0.1 am Mediencampus Dieburg

Leaf wird erstmals „bewohnt“

Aufklärung

Da das Projekt ein Experiment ist und somit zunächst nicht als solches erkannt werden sollte, bedarf es am Ende des Tests einer Auflösung. Wichtig ist uns hierbei ein humorvolles Ende des Experimentes, um mögliche negative Emotionen abzufangen, welche durch die Auflösung entstehen könnten. Unsere Nutzer sollen mit einer positiven Erfahrung und einem gestärkten Bewusstsein unsere Umgebung verlassen.

Dies wird vom Raum selbst übernommen. Sobald eine Person aufsteht und deutlich wird, dass sie den Raum verlässt, soll diese aufgehalten werden. Hier wollen wir sehr abrupt vorgehen, um die Aufmerksamkeit der Person zu erhalten und ein klares Zeichen zum Ende des Versuchs zu signalisieren. Dies wird durch Lautes Klatschen und Jubeln über die Lautsprecher im Raum vermittelt.

Anschließend wird ein humorvolles selbst komponiertes Lied abgespielt, in dem der Raum sozusagen zu den Menschen spricht und ihnen erklärt, dass sie Teil eines Experiments waren. Im Lied werden die verschiedenen Manipulationstechniken und Sinne, die verändert wurden nacheinander angesprochen und zeitgleich verändern sich diese im Raum zurück zu ihrer Anfangsposition.

Intelligenz

Die Intelligenz des Raumes zeichnet sich nicht nur durch reaktives Verhalten aus (z.B. eine Person setzt sich auf das Sofa, also schaltet sich dort unbemerkt ein Wärmekissen an).

Wenn man von Ambient Intelligence spricht, geht man idealerweise davon aus, dass der Raum auch in der Lage ist, zu lernen und zu komplexeren Interaktionen als simplen Reaktionsmustern fähig ist.

Leaf kann mit HIlfe verbauter Drucksensoren den Zeitpunkt messen, wann Personen sich in der Chillout Area niederlassen und wann sie diese wieder verlassen. Durch Emotionserkennung kann Leaf ungefähr abschätzen, wie zufrieden die Personen sich gerade fühlen und steuert anhand dieser Information das Manipulationsprogramm. Man kann sich Leaf also wie einen DJ vorstellen, der anhand der Reaktion seines Publikums lernt, wie er die verschiedenen Sinnesreize am Besten mixt.

So wird mit der Zeit die Manipulation immer genauer und läuft nicht immer nach dem gleichen Schema ab, sondern passt sich auch an die Personen an, die sich gerade im Raum befinden. Gleichzeitig kann Leaf auf vorherige Erfahrungen hinsichtlich der Reihenfolge der Sinnesreize und der Geschwindigkeit der Veränderung zurückgreifen.

Emotionserkennung

Der Raum reagiert auf die Emotionen des Nutzers. Dafür sind zum einen eine Kamera und zum anderen eine Anwendung notwendig, die Gesichtsausdrücke analysiert. Wir haben uns dabei für den Microsoft Cloud Service Azure entschieden.

Die sogenannte “Face API” von Microsoft’s Cloud Service Azure analysiert Bilder und gibt verschiedene Gesichtsattribute wieder. Eines dieser Attribute ist die Emotion des Gesichts. Die Emotion ist in verschiedene Unterkategorien aufgeteilt:

anger, contempt, disgust, fear, happiness, neutral, sadness und surprise.

Sofern ein Nutzer im Raum ist, analysiert die Universal-Windows-Platform-Anwendung von Leaf alle 10 Sekunden das Gesicht. Die verschiedenen Emotionen werden dann in eine allgemeine Stimmung umgerechnet, die einen Wert zwischen 0 und 1 hat. Die neutrale Emotion bildet den Mittelpunkt von 0,5. Die positiven Emotionen erhöhen den Wert, die negativen Emotionen verringern ihn. Der ermittelte Stimmungswert wird dann in der Datenbank mit zugehöriger UserID und Timestamp gespeichert und vom Raspberry verwendet, um die Manipulationsgeschwindigkeit zu bestimmen.

Auch zur Bestimmung der User ID wird die Azure Face-API verwendet. DIe Gesichtsmetadaten des Nutzers werden mit den jeweils vorherigen verglichen. Sobald sich das Gesicht mit zur Sicherheit angrenzender Wahrscheinlichkeit von dem vorherigen unterscheidet, wird die User ID geändert und Leaf beginnt von Neuem. Die Metadaten werden für 24 Stunden auf den westeuropäischen Microsoft-Servern gespeichert und danach laut Angaben von Microsoft gelöscht. Die User ID, die auf der Datenbank von Leafgespeichert wurde, führt nicht auf die Metadaten der Analyse zurück, unsere Auswertungsergebnisse sind also komplett anonym.

Datensammlung zur Auswertung

Um die analysierten Emotionsausdrücke und die daraus resultierenden Werte für die Auswertung abzuspeichern, benutzen wir eine lokale MySQL-Datenbank auf dem Raspberry Pi. Während des Versuchablaufs wird auf die Datenbank zugegriffen, um in Abhängigkeit dessen die Raumsituation anzupassen. Die Entscheidung für eine lokale MySQL-Datenbank basiert zum einen aus Kostengründen, zum anderen auf der geringen Datenmengen, von denen wir während der Ausstellung ausgehen.

Manipulation des Raumes

Für die Manipulation des Raumes nutzen wir einen Raspberry Pi 3 (Model B+). Nicht nur die Datenbank ist hier gelagert, sondern auch die Ansteuerungslogik. Ziel ist es, mindestens drei Sinne im Raum zu manipulieren: Den visuelle Sinn, den akustische Sinn und das Temperaturempfinden. Aus diesem Grund haben wir uns für die folgenden drei Komponenten entschieden:

Musik

Je nach Stimmung des Nutzers variiert die Lautstärke der Störgeräusche und der Entspannungsmusik. Als stetig änderbare Variable nutzen wir die Abstufungen der Lautstärke. Für die Entspannungsmusik haben wir uns für Exemplare aus der Audiobilbiothek von „Non-Copyright Music“ entschieden:

Track 01

Track 02

Track 03

Track 04

Track 05

Wichtig war uns, passende und lizenzfreie Musik zum Kontext der IF-Ausstellung zu finden.

Als Störgeräusche haben wir für einen „High Pitch“-Ton und ein summendes Fliegengeräusch entschieden:

High Pitch Sound

Sound of a fly

Ventilator

Passend zur sommerlichen Jahreszeit während der IF Ausstellung nutzen wir Ventilatoren im Raum. Mit Hilfe eines Relays können diese an- und ausgeschaltet werden.

Beleuchtung

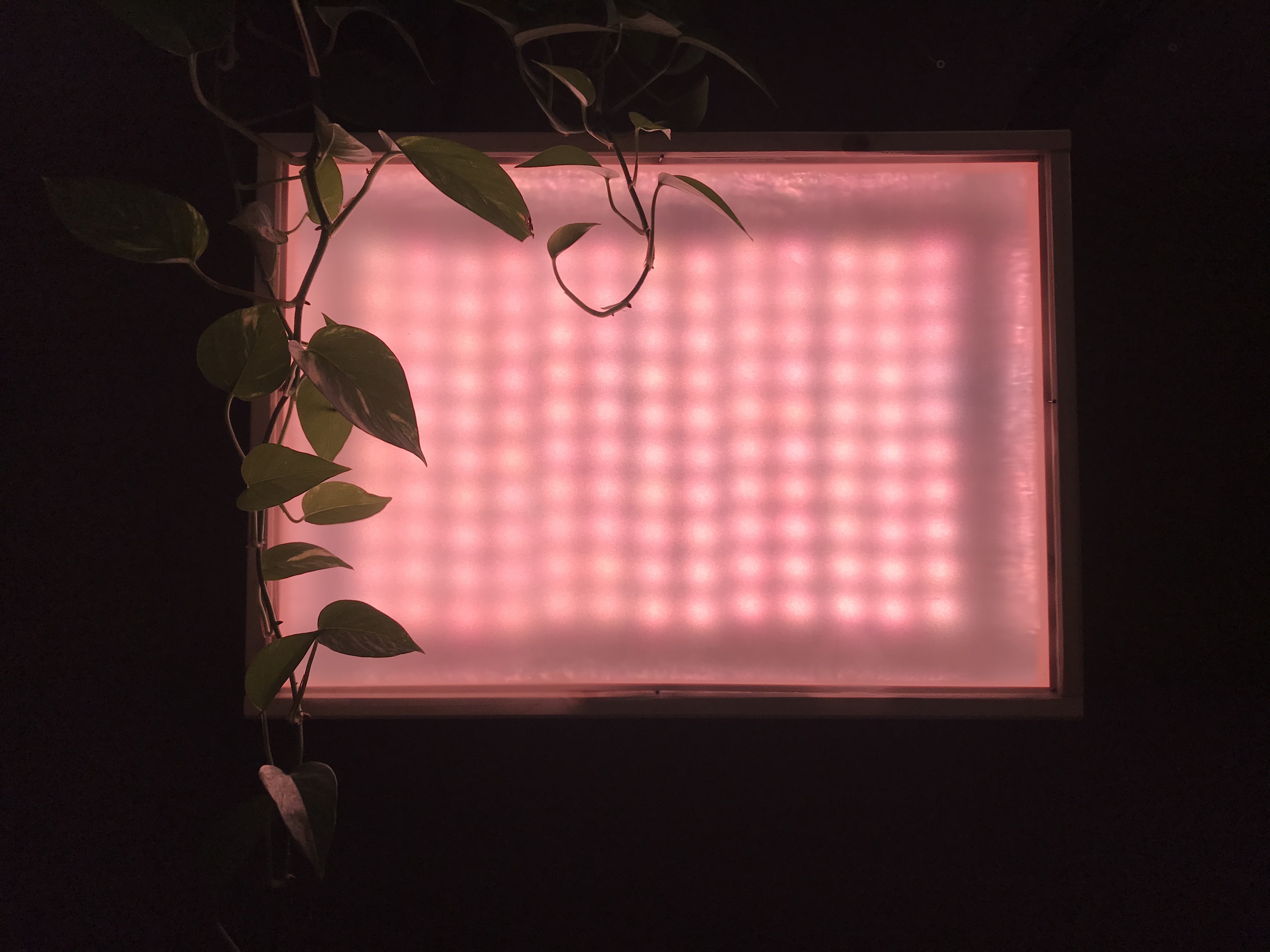

Für die Beleuchtung steuern wir den Farbton der LED Streifen. Sie befinden an der oberen Kante der Pflanzenwand und sind zusätzlich in der Softbox verbaut.

Beispiel für Lo-Fi Musik, die im Raum gespielt wird.

VORSICHT: Vor dem Anhören Lautstärke runterdrehen.

Beispiel für einen High Pitch Sound, der in die Musik eingebettet und verstärkt werden kann.

VORSICHT: Vor dem Anhören Lautstärke runterdrehen.

Beispiel für den Sound einer Fliege, der in die Musik eingebettet und verstärkt werden kann.